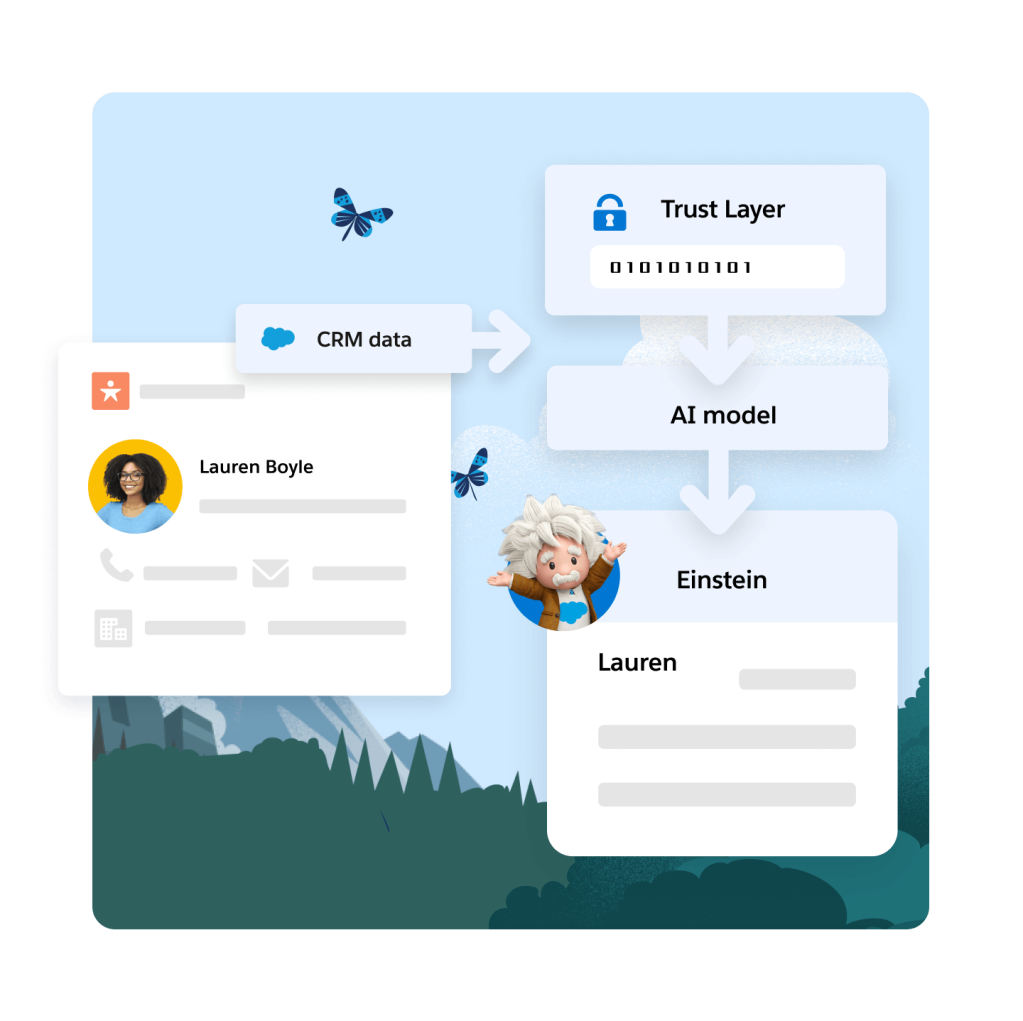

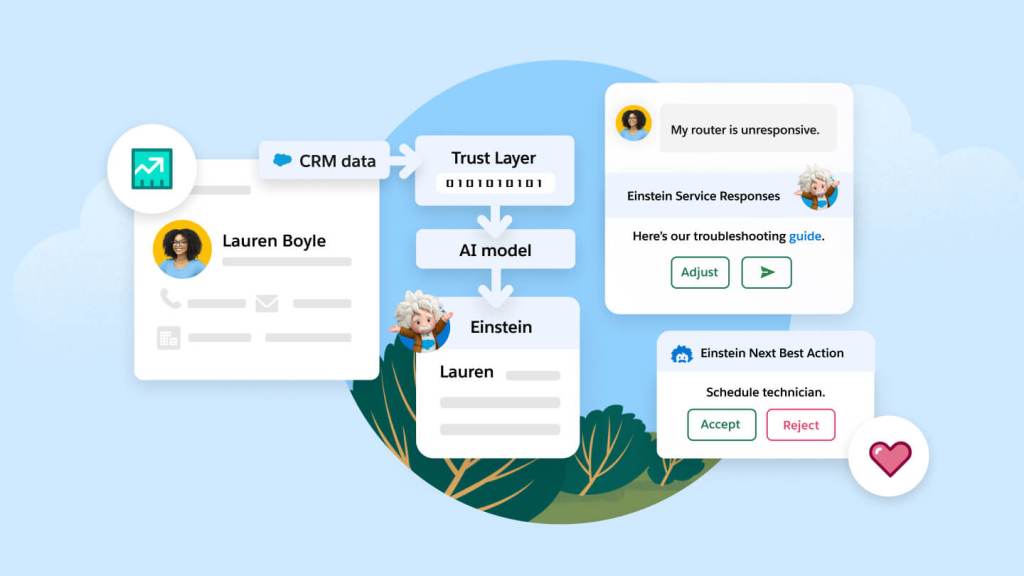

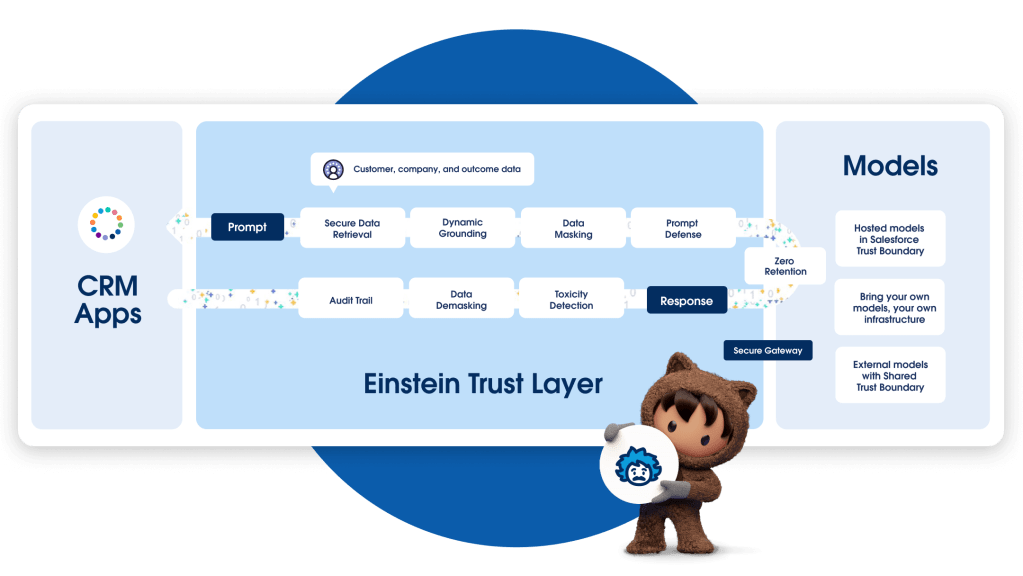

Camada de confiança do Einstein

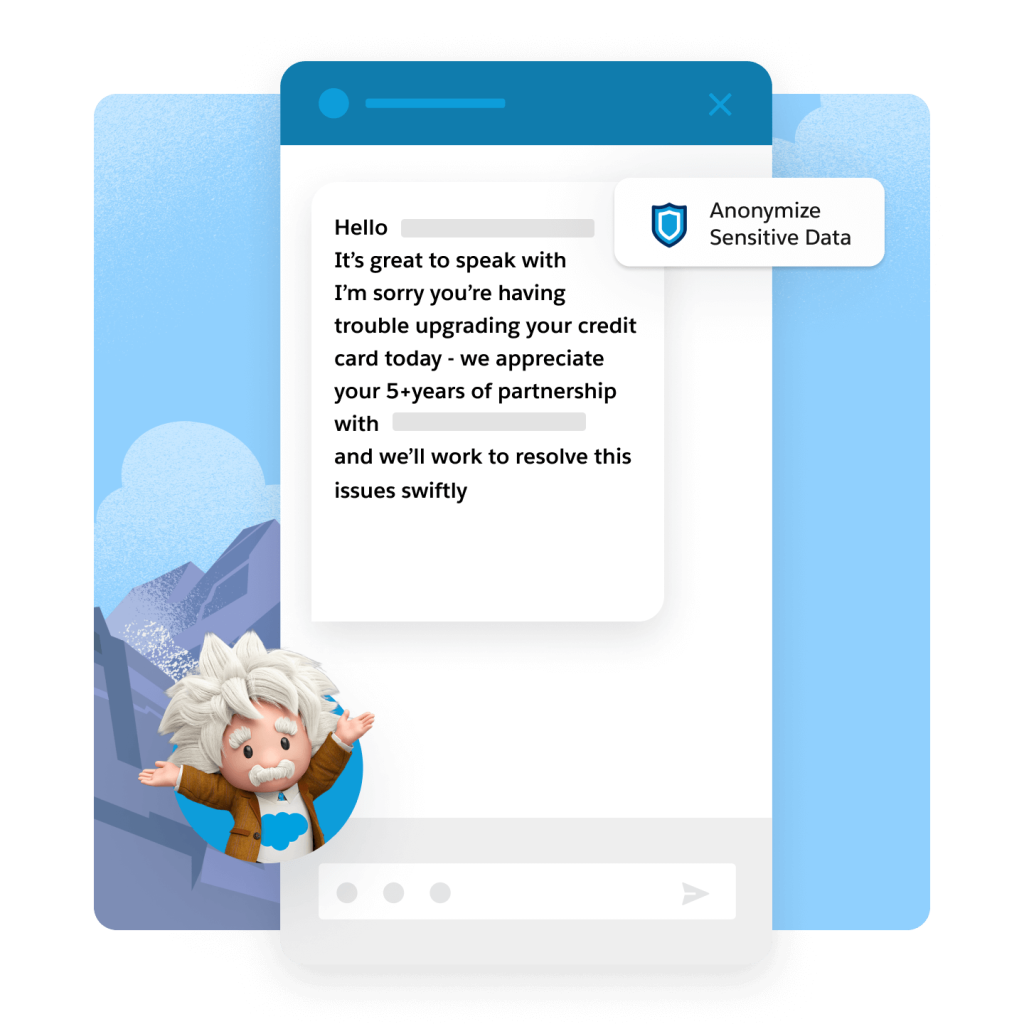

A Camada de confiança do Einstein é uma arquitetura de IA segura e integrada nativamente à Salesforce Platform. Desenvolvida no Hyperforce para conformidade e residência de dados, a Camada de confiança do Einstein é equipado com as melhores proteções de segurança desde o produto até as nossas políticas. Projetada para os padrões de segurança empresarial, a Camada de confiança do Einstein permite que as equipes se beneficiem da IA generativa sem comprometer os dados dos clientes.