In Salesforce siamo guidati dai nostri cinque valori fondamentali: fiducia, successo dei clienti, innovazione, uguaglianza e sostenibilità. Siamo inoltre impegnati profondamente nello sviluppo e nell’utilizzo responsabile della tecnologia, sotto la guida del nostro Ufficio per l’uso etico e umano.

Una delle tecnologie emergenti che ha un grande potenziale per migliorare lo stato del mondo è l’intelligenza artificiale (AI), in quanto aumenta l’intelligenza umana, amplifica le capacità umane e fornisce informazioni utili per ottenere risultati migliori per i nostri dipendenti, clienti e partner.

Crediamo che i vantaggi dell’AI debbano essere accessibili a tutti. Ma non è sufficiente fornire solo le capacità tecnologiche dell’AI: abbiamo l’importante responsabilità di garantire che questa tecnologia sia sicura e inclusiva per tutti. Prendiamo sul serio questa responsabilità e ci impegniamo a fornire ai nostri dipendenti, clienti e partner gli strumenti necessari per sviluppare e utilizzare l’AI in modo sicuro, accurato ed etico.

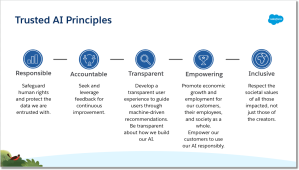

I nostri principi

Nel 2018 abbiamo iniziato a definire i nostri principi di fiducia sull’AI e volevamo assicurarci che fossero specifici per i prodotti, i casi d’uso e i clienti di Salesforce. Questo percorso è durato un anno, e in questo periodo abbiamo sollecitato il feedback dei singoli collaboratori, dei manager e dei dirigenti dell’azienda, in tutte le organizzazioni, tra cui ingegneria, sviluppo del prodotto, UX, scienza dei dati, ufficio legale, equità, affari governativi e marketing. I principi sono stati approvati dai dirigenti di tutti i cloud e di tutti i ruoli, compresi i nostri co-CEO di allora, Marc Benioff e Keith Block. Come abbiamo discusso nel nostro Modello di Maturità dell’AI Etica, anche se questo percorso può sembrare lungo, si tratta di un’esperienza formativa importante per garantire che tutti in azienda abbiano dato un contributo, compreso la loro responsabilità nel rispettare questi principi e si siano impegnati ad attuarli nel loro lavoro quotidiano.

Affidabilità

Ci impegniamo a salvaguardare i diritti umani, a proteggere i dati che ci vengono affidati, a rispettare gli standard scientifici e ad applicare le politiche contro gli abusi. Ci aspettiamo che i nostri clienti utilizzino la nostra AI in modo responsabile e nel rispetto degli accordi che hanno preso con noi, tra cui figura la nostra Politica sull’uso accettabile.

Responsabilità

Crediamo nella responsabilità nei confronti dei nostri clienti, dei nostri partner e della società. Raccoglieremo feedback indipendente per migliorare continuamente le nostre pratiche e le nostre politiche e lavoreremo per mitigare i danni ai clienti e ai consumatori.

Trasparenza

Ci impegniamo a garantire che i nostri clienti comprendano il “perché” di ogni raccomandazione e previsione guidata dall’intelligenza artificiale, così che possano prendere decisioni informate, identificare gli esiti indesiderati e ridurre i danni.

Potenziamento

Riteniamo che l’intelligenza artificiale venga utilizzata al meglio se abbinata alle capacità umane, aumentando le persone e consentendo loro di prendere decisioni migliori. Aspiriamo a creare una tecnologia che permetta a tutti di essere più produttivi e di avere un impatto maggiore all’interno delle loro organizzazioni.

Inclusività

L’AI dovrebbe migliorare la condizione umana e rappresentare i valori di tutte le persone coinvolte, non solo dei creatori. Promuoveremo la diversità, l’uguaglianza e l’equità attraverso l’AI.

Dai principi alla pratica

Avere una serie di principi non è sufficiente. L’etica è un lavoro di squadra e, per essere significativa, tutti i membri dell’azienda devono comprendere le proprie responsabilità nel rispettare questi principi. Di seguito sono riportati alcuni esempi di come abbiamo tradotto in pratica questi principi.

Come Salesforce mette in pratica i principi di AI affidabili

Affidabilità

Prima di creare qualsiasi funzionalità di intelligenza artificiale, ci chiediamo non solo se possiamo fare qualcosa, ma anche se dovremmo farlo. Collaboriamo con esperti esterni di diritti umani per imparare, crescere e scoprire sempre nuovi modi per proteggere i diritti umani.

Offriamo formazione e mettiamo i nostri clienti in condizione di prendere decisioni informate su come utilizzare la nostra AI in modo responsabile. Lo facciamo creando strumenti e risorse per aiutare i dipendenti, i clienti e i partner di Salesforce a identificare e mitigare i pregiudizi nei sistemi che stanno costruendo e utilizzando (ad esempio, segnalando l’utilizzo di categorie di dati protetti e variabili proxy in un modello, fornendo trasparenza sui fattori che influenzano maggiormente le previsioni individuali), consentendo a clienti e partner di comprendere la responsabilità che hanno nell’adottare l’AI in modo sicuro e affidabile.

Ci atteniamo alle più rigorose pratiche di sicurezza e di privacy per anticipare e ridurre i danni involontari e a mantenere sicuri i nostri prodotti. Rispettiamo le leggi vigenti che normano la ricerca e l’uso dell’AI. Inoltre, ci impegniamo a rispettare i più alti standard scientifici e qualitativi nella nostra ricerca, garantendone la sicurezza e condividendola attraverso pubblicazioni peer-reviewed, conferenze ed eventi di settore.

Responsabilità

Collaboriamo con esperti nel campo dei diritti umani e dell’etica tecnologica attraverso il nostro Consiglio consultivo sull’uso etico e diversi workshop. Invitiamo inoltre i nostri clienti a fornire il loro feedback attraverso i Customer Advisory Board e il dialogo aperto e integriamo queste opinioni nel nostro processo decisionale.

Per noi, dare un contributo al nostro settore e alla società è importante. Per farlo, collaboriamo con i nostri colleghi attraverso gruppi di settore, forum della società civile e organizzazioni governative (ad esempio, US National Institute of Standards and Technology, US National AI Advisory Committee, Singapore’s Advisory Council on the Ethical Use of AI and Data) per migliorare continuamente le nostre pratiche e politiche.

Permettiamo ai dipendenti di sollevare domande e dubbi attraverso canali come il nostro sistema di governance e reporting aziendale online anonimo, i canali Slack e l’indirizzo e-mail di gruppo.

Trasparenza

La trasparenza comprende sì il modo in cui costruiamo i nostri modelli, ma anche il motivo per cui hanno fatto la previsione o la raccomandazione che hanno fatto. Pubblichiamo schede modello che descrivono come sono stati creati i modelli, i casi d’uso previsti e non previsti, le implicazioni etiche o sociali note e i punteggi delle prestazioni. Forniamo anche la spiegabilità del modello quando viene fatta una previsione o una raccomandazione dall’intelligenza artificiale.

Permettiamo ai clienti di mantenere sempre il controllo dei dati e dei modelli. I dati che gestiamo non appartengono a Salesforce, ma al cliente. Inoltre, forniamo ai clienti una chiara informativa sui termini d’uso e sulle applicazioni previste per le funzionalità di AI di Salesforce.

Potenziamento

Ci impegniamo per astrarre la complessità dell’AI e rendere quindi possibile a persone di qualsiasi livello tecnico, non solo ai data scientist avanzati, di costruire applicazioni di AI con semplici clic, non scrivendo codice. Inoltre, progettiamo e offriamo formazione gratuita sull’intelligenza artificiale tramite Trailhead per consentire a chiunque di acquisire le competenze necessarie per lavorare nell’era della quarta rivoluzione industriale. Includiamo strumenti come la misurazione dell’impatto disparato (una definizione di pregiudizio) e il popolamento automatico delle schede modello (come le etichette nutrizionali per i modelli), oltre a fornire una guida all’interno dell’app in modo che i clienti sappiano come utilizzare la nostra AI in modo responsabile.

Il team di Salesforce che si occupa di AI è impegnato a fornire scoperte nel campo della ricerca sull’intelligenza artificiale per informare nuove categorie di prodotti e garantire che i nostri clienti siano all’avanguardia nei progressi tecnologici.

Inclusività

Testiamo i nostri modelli utilizzando insiemi di dati diversi e rappresentativi, i più adatti all’utilizzo. Cerchiamo di capire l’impatto dei servizi di AI su un’ampia gamma di clienti, utenti finali e contesti. A tale scopo, conduciamo workshop di scansione delle conseguenze e workshop di creazione con intenzioni. Inoltre, ci impegniamo a costruire team inclusivi che rappresentino esperienze e punti di vista diversi, allineandoci al nostro valore fondamentale dell’uguaglianza.

Siamo una cosa sola. E lavoriamo insieme

In Salesforce crediamo che l’uso etico di tecnologie avanzate come l’AI sia una questione sempre più complessa. Questo argomento deve essere affrontato con chiarezza, non solo da noi, ma da tutto il settore. Siamo favorevoli a un dialogo tra più soggetti che includa i nostri dipendenti, i clienti, i partner e le comunità.

Collaborando per risolvere le sfide emergenti e garantire che questi nuovi progressi tengano conto delle diverse esperienze, possiamo guidare il cambiamento positivo con il potere dell’AI, nonché guidare lo sviluppo dell’AI con la prospettiva che ci aiuta a sfruttare al meglio il potenziale umano.